Η εμπιστοσύνη είναι το πιο σκληρό νόμισμα στον ψηφιακό κόσμο και η Google φαίνεται πως μόλις ξόδεψε ένα τεράστιο ποσό από αυτό το κεφάλαιο. Η απόφαση του τεχνολογικού γίγαντα να περιορίσει δραστικά τις AI Overviews σε θέματα υγείας δεν είναι απλώς μια τεχνική διόρθωση. Είναι η παραδοχή μιας ήττας σε ένα πεδίο που δεν συγχωρεί λάθη. Την ανθρώπινη ζωή.

Όλα ξεκίνησαν με την υπόσχεση πως η Τεχνητή Νοημοσύνη θα μας έδινε γρήγορες, μασημένες απαντήσεις χωρίς να χρειάζεται να ψάχνουμε σε δέκα διαφορετικά site. Όμως η πραγματικότητα αποδείχθηκε τρομακτική. Χρήστες βρέθηκαν μπροστά σε αλγοριθμικές προτάσεις που δεν ήταν απλώς ανακριβείς αλλά δυνητικά θανατηφόρες. Το να βλέπεις μια μηχανή να προτείνει «λύσεις» που αντιβαίνουν κάθε ιατρική λογική δεν είναι ένα bug. Είναι ένα δομικό πρόβλημα στον τρόπο που τα γλωσσικά μοντέλα αντιλαμβάνονται την αλήθεια.

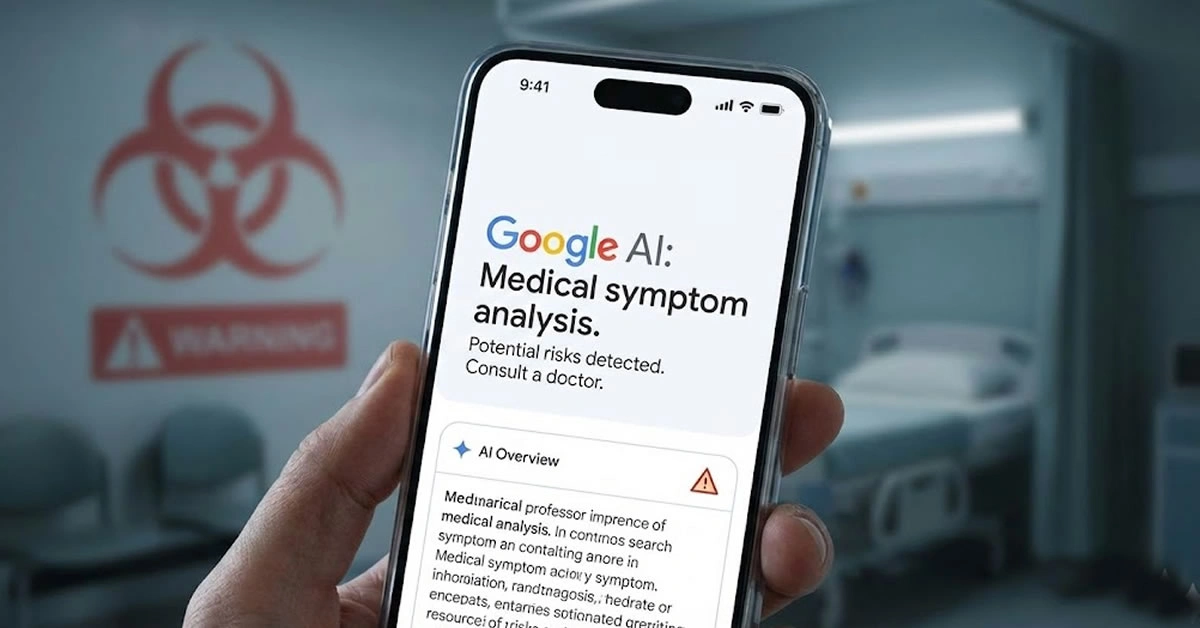

[ΠΡΟΤΑΣΗ ΤΟΠΟΘΕΤΗΣΗΣ ΕΙΚΟΝΑΣ ΕΔΩ: Μια κοντινή λήψη ενός χεριού που κρατάει κινητό με το logo της Google, ενώ στο φόντο υπάρχει θολωμένο ένα ιατρικό περιβάλλον ή χάπια, για να τονιστεί η αντίθεση τεχνολογίας και υγείας.]

Η κίνηση της εταιρείας να τραβήξει την πρίζα δείχνει πανικό. Δείχνει πως στο κυνήγι του εντυπωσιασμού και του ανταγωνισμού με άλλες εταιρείες AI, παρακάμφθηκαν δικλείδες ασφαλείας που έπρεπε να είναι αδιαπέραστες. Δεν μιλάμε για μια λάθος ημερομηνία σε ιστορικό γεγονός. Μιλάμε για ιατρικές οδηγίες. Αυτό το γεγονός θέτει υπό αμφισβήτηση ολόκληρο το αφήγημα της Silicon Valley πως η τεχνολογία είναι έτοιμη να αναλάβει ρόλο συμβούλου σε κρίσιμα ζητήματα.

Ο κίνδυνος του «Γιατρού Google» στην Ελλάδα

Στη χώρα μας το πρόβλημα αυτό αποκτά άλλη διάσταση. Στην Ελλάδα η αυτοδιάγνωση μέσω διαδικτύου είναι σχεδόν εθνικό σπορ. Πριν επισκεφθούμε τον γιατρό, οι περισσότεροι έχουμε ήδη «γκουγκλάρει» τα συμπτώματα. Αν οι AI περιλήψεις φτάσουν να λειτουργούν πλήρως στα ελληνικά με την ίδια επιπολαιότητα, ο κίνδυνος πολλαπλασιάζεται. Η ελληνική γλώσσα έχει ιδιαιτερότητες που συχνά μπερδεύουν τα μεταφραστικά μοντέλα και μια μικρή παρερμηνεία σε ιατρικό όρο μπορεί να οδηγήσει σε καταστροφικά συμπεράσματα.

Το περιστατικό αυτό λειτουργεί ως καμπανάκι για τον Έλληνα χρήστη. Μας υπενθυμίζει βίαια πως η οθόνη του κινητού δεν μπορεί να αντικαταστήσει τον ειδικό. Όσο βολικό κι αν είναι το Search, η κριτική σκέψη παραμένει το μοναδικό μας όπλο. Δεν πρέπει να δεχόμαστε αμάσητη τροφή από κανέναν αλγόριθμο, ειδικά όταν το διακύβευμα είναι η σωματική μας ακεραιότητα.

Η επόμενη μέρα για την αναζήτηση

Αυτό το πισωγύρισμα θα αφήσει σημάδια. Η Google θα χρειαστεί πολύ χρόνο για να πείσει ξανά το κοινό πως οι αυτοματοποιημένες απαντήσεις της είναι ασφαλείς. Το περιστατικό αποδεικνύει πως τα Large Language Models έχουν την τάση να «παραισθαίνονται», να φτιάχνουν δηλαδή πειστικά ψέματα. Όταν αυτό συμβαίνει σε μια συνταγή μαγειρικής, είναι αστείο. Όταν συμβαίνει σε θέματα υγείας, είναι εγκληματικό.

Βρισκόμαστε σε ένα κρίσιμο σταυροδρόμι. Η τεχνολογία τρέχει πιο γρήγορα από την ηθική και την ασφάλεια. Το φρένο που πάτησε η εταιρεία ήταν αναγκαίο, αλλά η ζημιά στην αξιοπιστία έχει γίνει. Από εδώ και πέρα κάθε φορά που θα βλέπουμε μια έτοιμη απάντηση στην κορυφή της αναζήτησης, θα υπάρχει πάντα μια φωνή στο πίσω μέρος του μυαλού μας να ρωτάει αν αυτό που διαβάζουμε είναι αλήθεια ή απλώς μια επικίνδυνη μαντεψιά μιας μηχανής.

Η Χριστίνα Κατσαρού είναι δημοσιογράφος με πολυετή εμπειρία στο κοινωνικό ρεπορτάζ και την αρθρογραφία. Με σπουδές στη δημοσιογραφία και πάθος για την ανάδειξη της ανθρώπινης πλευράς των γεγονότων, έχει εστιάσει την καριέρα της στην καταγραφή εμπειριών που συχνά μένουν στο περιθώριο.

Στο Newsblog.gr, η Χριστίνα αναλαμβάνει την επιμέλεια της ενότητας «Ιστορίες Ζωής», δίνοντας φωνή σε ανθρώπους που εμπνέουν με τη δύναμη, την ανθεκτικότητα και τα βιώματά τους. Πιστεύει ακράδαντα ότι πίσω από κάθε πρόσωπο κρύβεται μια μοναδική αφήγηση που αξίζει να ακουστεί, και στόχος της είναι να μεταφέρει αυτές τις ιστορίες με σεβασμό, ενσυναίσθηση και δημοσιογραφική δεοντολογία.